PUE悪化の最大の要因は「熱」

前回の記事では、データセンターの収益性を左右する最重要指標「PUE(電力使用効率)」について解説しました。この数値を悪化させる(=燃費を悪くする)一番の原因は、サーバーの発熱を抑えるための「空調・冷却設備」が消費する電力です。

データセンターにズラリと並ぶ無数のサーバーは、稼働するために消費した電力のほぼ100%を「熱」として外に吐き出します。 もし空調を止めて放置すれば、室内は数分で40度、50度という真夏の車内のような温度まで跳ね上がります。そのままではサーバーの頭脳が「熱暴走」を起こし、私たちが普段使っているアプリやサービスが完全に停止(システムダウン)してしまうのです。

私は現役のデータセンターエンジニアとして、この「巨大な熱」をいかに少ない電力で効率よく冷やすか、という課題に日々向き合っています。

これから先のAI時代、熱を処理する主流は「液体で冷却する技術(液冷)」へとシフトしていくと言われています。しかし、その次世代技術の本当の凄さを理解するには、まず現在のインフラを支えている「空気で冷やす技術(空冷)」の基本を知る必要があります。

本記事では、巨大な精密機械をどうやって冷やし続けているのか、その仕組みと、そこから見えてくるインフラ投資の視点を、初心者の方にも分かりやすく解説します。

第1章:オフィスのエアコンとは全く違う!データセンターならではの「冷やし方」

一般的なオフィスビルのエアコンは、天井から冷風を吹き出し、部屋全体をふんわりと均等に涼しくするように設計されています。しかし、巨大な熱を発するデータセンターで同じことをすると、あっという間に熱に負けてしまい、全く冷却が追いつきません。

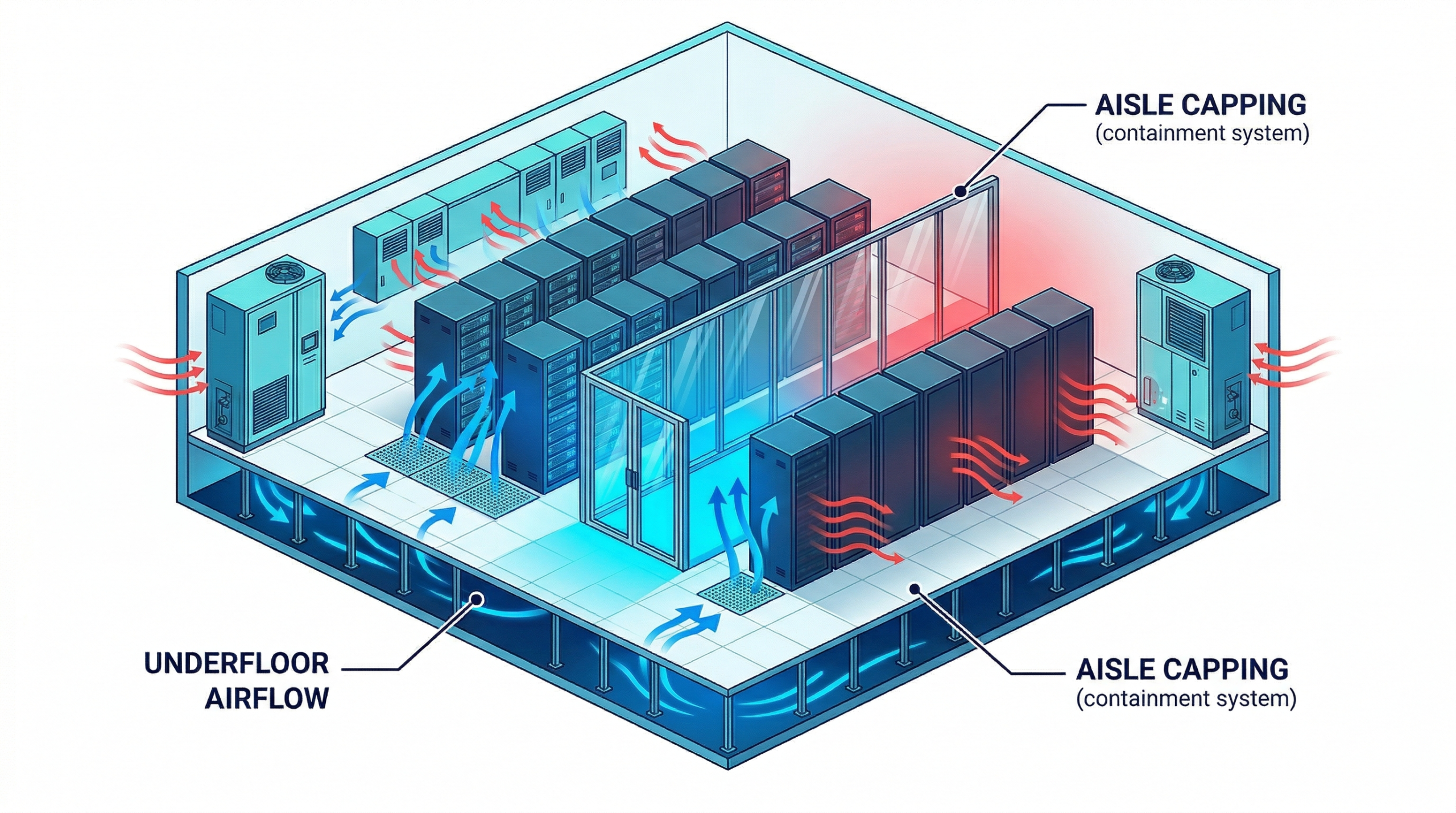

そのため、データセンターでは建物の物理的な構造から「全く異なるアプローチ」をとっています。その代表的な仕組みが「床下送風」と「アイルキャッピング」です。

1. 床下から冷風が突き上げる「二重床(床下送風)」方式

データセンターのサーバー室に足を踏み入れると、通常のオフィスよりも床が一段高くなっている、あるいは天井までの高さ(階高)が異様に高いことに気がつくはずです。

これは「フリーアクセスフロア」と呼ばれる二重構造で、実はこの底上げされた床下の空間全体が、冷たい空気を運ぶ巨大な「通り道(ダクト)」になっているのです。

部屋の壁際には、大型の精密空調機(専門用語でCRACやAHU、CRAHUなどと呼ばれます)がズラリと並んでいます。これらが作動すると、作られた冷風が床下を勢いよく走り抜け、サーバーラックの目の前にある「穴の開いた床パネル」から上に向かって噴き出します。

サーバーは、その新鮮な冷気を前面から力強く吸い込み、内部の熱い半導体を直接冷やします。部屋全体を冷やすのではなく、**「冷やしたい機械の目の前に、直接冷気を届ける」**という無駄のない仕組みです。

2. 冷気と熱気を絶対に混ぜない「アイルキャッピング」

サーバーが前面から冷気を吸い込むと、背面からはドライヤーのような強烈な「熱風」が吐き出されます。

ここで私たち設備エンジニアが最も警戒するのはせっかく作った「冷たい空気」と、排出された「熱い空気」が部屋の中で混ざってしまうこと(ショートサーキット現象)です。

ぬるい空気を吸い込むとサーバーの冷却効率が急激に落ちるだけでなく、空調機が余分な電力を使ってさらに空気を冷やし直さなければならないため、PUE(燃費)が一気に悪化してしまいます。

これを防ぐための物理的な壁が「アイルキャッピング」です。

サーバーの吸気側(冷たい通路)、あるいは排気側(熱い通路)を、ガラスの扉や天井パネルで完全に覆って囲い込み、冷気と熱気が絶対に混ざらないように空間を分離します。 現場のエネルギー管理において、この「気流(空気の流れ)」をいかに綺麗にコントロールし、無駄なく冷やすかが、私たちエンジニアの腕の見せ所でもあります。

第2章:なぜ「空気」ではダメなのか?データセンター空調に迫る限界

これまで長年にわたり、データセンターは第1章で解説したような工夫を凝らし、「空気(風)」を使ってサーバーを冷やし続けてきました。

しかし現在、多くのデータセンターでは深刻な課題に直面しています。それが「空冷(空気で冷やす技術)の物理的な限界」です。 その最大の原因の一つとして、生成AIの普及による「サーバーの異常な発熱」があります。

AIサーバーはケタ違いの熱を出す

従来の一般的なサーバーと、最新のAI向けGPUを搭載したサーバーでは、消費する電力、つまり「発生する熱量」が全く違います。

一つのサーバーラック(ロッカーのようなサーバーの収納棚)あたりの消費電力で比較してみましょう。従来は「数キロワット(一般家庭数軒分)」程度で収まっていました。しかし、最新のAIサーバーラックは「数十キロワット〜100キロワット超」と、文字通りケタ違いの電力を消費します。

これは例えるなら、「電話ボックスほどの狭い空間の中で、数十台から数百台のドライヤーを同時にフル稼働させている」ような、異常な熱量です。

「空気を当てる」ことの物理的な限界

発熱量がここまで跳ね上がると、どれだけ床下から冷風を大量に送り込んでも、空気が熱を奪うスピードが全く追いつかなくなります。

そもそも「空気」という物質は、熱を蓄えたり運んだりする能力が非常に低いのです。中学理科で習ったように、空気は「比熱(熱の蓄えやすさ)」がとても小さいという特徴があります。 たとえば、真冬に気温が0度でも人間はなんとか外を歩けますが、0度の氷水に入ったら一瞬で凍えてしまうのと同じで、空気は液体に比べて「熱を奪う効率が極めて悪い」という弱点を持っているのです。

それでも無理に空気で冷やそうとすれば、空調機やサーバー内蔵の冷却ファンを「台風のような猛烈な勢い」で回し続けるしかありません。

しかし、ファンを全力で回せば回すほど、今度はファンを回すモーター自体が膨大な電力を消費してしまいます。これでは何のために冷却しているのか本末転倒となり、「PUE(燃費)」は悪化の一途を辿るという、完全な悪循環(負のループ)に陥ってしまいます。

「空気で冷やす」というアプローチそのものが、物理法則の壁にぶつかっている。 これが、現在のデータセンター業界が抱える最大のジレンマなのです。

第3章:奪った熱はどこへ行く?データセンターを支える「熱源設備」

第1章では、サーバー室の中でどうやって冷たい風を当てサーバーから熱を奪うかを解説しました。第3章ではサーバーから奪った大量の「熱」が一体どこへ消えているかを解説します。

熱をサーバーからうばってそのあとは魔法のように消えてなくなるわけではありません。データセンターの空調の真の姿は、「室内の熱を、水や冷媒を使って建物の外(大気中)へバケツリレーのように運び出して捨てる」という巨大なシステムなのです。

1. 縁の下の力持ち「チラー」と「冷却塔」

大型データセンターの屋上や敷地内には、サーバー室の空調機(CRACなど)に「冷たい水」を送り続けるための巨大な設備が鎮座しています。

- チラー(熱源機): 家庭用の冷蔵庫やエアコンの室外機を超巨大にしたような設備です。電気(コンプレッサー)の力を使って、水をキンキンに冷やします。ここで最も多くの電力を消費します。

- 冷却塔(クーリングタワー): チラーが水を冷やす過程で出た「熱」を、最終的に外の空気に放出するための巨大な煙突のような設備です。

室内にある空調機は、このチラーから送られてくる「冷水」を使って冷風を作り、熱を吸ってぬるくなった水をまたチラーへ送り返す、という循環を24時間365日休まず繰り返しています。

2. 自然の力を借りてPUEを下げる「外気冷房(フリークーリング)」

チラーは巨大なコンプレッサーを回すため、膨大な電力を消費します(これがPUEを悪化させる原因です)。そこで活用するのが、自然の寒さを利用する「外気冷房(フリークーリング)」という技術です。

秋から冬にかけて外の気温が十分に下がると、電気を大食いするチラーのコンプレッサーを停止(または出力を弱め)させます。代わりに、外の冷たい空気を使って「直接、冷却水を作る」モードに切り替えるのです。

冬場に窓を開けて部屋を涼しくするのと同じ理屈ですが、これを数十メガワットという規模で行います。外気冷房が稼働している期間は空調にかかる電力が劇的に下がるため、PUEの数値が目に見えて良くなります。北海道などの寒冷地にデータセンターが建設されやすいのは、この「外気冷房を使える期間が圧倒的に長いから」という明確な理由があるのです。

コメント